计算机视觉 哪些技术

作者:科技教程网

|

84人看过

84人看过

发布时间:2026-02-20 08:29:01

标签:计算机视觉 哪些技术

计算机视觉技术涵盖了图像识别、目标检测、语义分割、三维重建、行为分析等多个关键领域,通过深度学习、特征提取和模型优化等方法,为自动驾驶、医疗影像、工业检测等应用提供核心解决方案,帮助用户全面理解并掌握计算机视觉 哪些技术的核心体系与实践方向。

当我们谈论“计算机视觉 哪些技术”时,许多从业者或初学者脑海中可能会浮现出一些零散的概念,比如人脸识别、图像分类,或是自动驾驶中的感知模块。然而,计算机视觉作为一个交叉学科,其技术体系远比表面所见更为丰富和深邃。今天,我们就来系统地梳理一下,计算机视觉究竟包含哪些核心技术,这些技术如何相互关联,又如何在现实场景中落地生根。

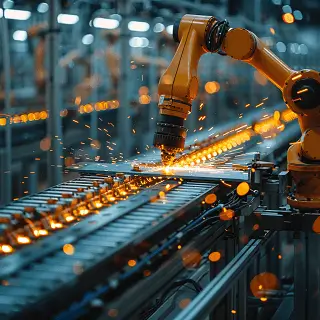

计算机视觉的核心技术究竟有哪些? 要回答这个问题,我们不能仅仅停留在列举几个热门算法上。一个更结构化的视角是,按照从“感知”到“理解”,再到“决策与生成”的技术流程来划分。下面,我们就沿着这条主线,逐一展开。 第一层是图像与视频的获取与预处理技术。任何视觉任务都始于原始数据。这包括成像技术本身,比如高动态范围成像(High Dynamic Range Imaging,简称HDR),它能让相机捕捉到更宽广的亮度范围,避免过曝或欠曝。还有计算摄影学中的多帧合成、夜景模式等,它们本质上是预处理技术,旨在提升输入图像的质量。预处理还包括去噪、增强、几何校正(如鱼眼镜头矫正)和色彩空间转换(例如从红绿蓝色彩空间(RGB)转换到色相饱和度明度色彩空间(HSV))。这些看似基础的工作,往往是后续高级算法能否稳定发挥的关键。没有干净的输入,再聪明的模型也会“看走眼”。 第二层是特征提取与描述技术。这是传统计算机视觉的基石。在深度学习普及之前,研究者们需要手工设计特征来描述图像中的关键信息。例如,尺度不变特征变换(Scale-Invariant Feature Transform,简称SIFT)算法,它能够检测并描述图像中的局部特征点,这些特征点对旋转、尺度缩放甚至亮度变化都保持一定的不变性,广泛应用于图像拼接和物体识别。类似的技术还有加速稳健特征(Speeded-Up Robust Features,简称SURF)、方向梯度直方图(Histogram of Oriented Gradients,简称HOG)等。尽管如今深度学习方法很大程度上自动化了特征学习的过程,但这些经典特征在特定领域(如计算资源受限的嵌入式设备)或作为补充信息时,仍有其不可替代的价值。 第三层,也是当前最核心的一层,是基于深度学习的图像识别与分类技术。这可以说是推动计算机视觉爆发式发展的引擎。其代表性架构是卷积神经网络(Convolutional Neural Network,简称CNN)。从早期的莱内特(LeNet)到引爆潮流的亚历克斯网络(AlexNet),再到更深的视觉几何组网络(VGGNet)、谷歌初始网络(GoogLeNet)、残差网络(ResNet),这些模型在图像分类任务上不断刷新记录。它们通过多层卷积层自动学习从边缘、纹理到物体部件的层次化特征,最终实现高精度的图像内容识别。这项技术是许多应用的基础,例如相册的自动归类、电商平台的以图搜图等。 第四层是目标检测与定位技术。分类只能告诉“是什么”,而检测还需要回答“在哪里”。这项技术需要在图像中找出所有感兴趣物体的位置(通常用边界框标出)并识别其类别。其发展历程经历了从两阶段方法到一阶段方法的演进。两阶段方法的代表是区域卷积神经网络系列(R-CNN, Fast R-CNN, Faster R-CNN),它首先生成候选区域,再对每个区域进行分类和边框回归。一阶段方法则更为高效,如单次多框检测器(SSD)和你只看一次(YOLO)系列,它们将检测任务视为一个统一的回归问题,速度更快,更适合实时应用。如今,目标检测已广泛应用于安防监控、自动驾驶中的车辆行人识别、工厂流水线上的产品质检等场景。 第五层是语义分割与实例分割技术。这是比目标检测更精细的感知任务。语义分割旨在为图像中的每一个像素分配一个类别标签,从而理解整个场景的布局,比如区分出天空、道路、车辆、行人。全卷积网络(Fully Convolutional Network,简称FCN)是开创性的工作。而实例分割则更进一步,不仅要做像素级分类,还要区分开同一类别的不同个体,例如图像中的多个人。掩模区域卷积神经网络(Mask R-CNN)是这一领域的标杆。这些技术对于自动驾驶的场景理解、医疗影像中的病灶区域勾画、遥感图像的土地利用分析至关重要。 第六层是三维视觉与重建技术。计算机视觉不仅要理解二维图像,还要恢复三维世界的结构和形状。立体视觉通过多视角图像(如双目摄像头)计算视差来获取深度信息。运动恢复结构(Structure from Motion,简称SfM)则从一系列二维图像中重建出三维场景和相机运动轨迹。此外,还有基于深度传感器的技术,如利用光飞行时间法(Time of Flight,简称ToF)或结构光原理的深度相机直接获取三维点云。三维重建技术在机器人导航、虚拟现实(Virtual Reality,简称VR)、增强现实(Augmented Reality,简称AR)、文物数字化保护等领域应用广泛。 第七层是运动分析与行为识别技术。当处理视频序列时,我们需要理解物体或人体的运动模式。光流法用于估计图像中每个像素点的运动矢量。在行为识别方面,早期使用时空兴趣点结合分类器的方法。如今,深度学习模型如双流网络(同时处理空间外观信息和时间运动信息)、三维卷积神经网络(3D CNN)以及长短时记忆网络(Long Short-Term Memory,简称LSTM)与卷积神经网络(CNN)的结合,能够有效地从视频中识别出走路、跑步、挥手等动作,甚至更复杂的行为序列。这在智能监控、人机交互、体育分析中非常重要。 第八层是图像生成与风格迁移技术。这标志着计算机视觉从“感知理解”走向了“创造”。生成对抗网络(Generative Adversarial Network,简称GAN)是其中的革命性框架,它通过生成器和判别器的对抗博弈,可以生成以假乱真的图像。变分自编码器(Variational Autoencoder,简称VAE)也是重要的生成模型。风格迁移则可以将著名画作的风格应用到普通照片上。这类技术正催生新的应用,如数据增强、艺术创作、游戏场景生成、老照片修复和面部属性编辑等。 第九层是视觉里程计与同步定位与地图构建(SLAM)技术。这是移动机器人和自动驾驶的核心。视觉里程计仅通过摄像头连续图像来估计机器人自身的运动。而同步定位与地图构建(SLAM)则同时解决“定位”和“建图”两个问题,即在未知环境中,一边估计自身位置,一边构建环境地图。根据传感器不同,有视觉同步定位与地图构建(V-SLAM,使用普通摄像头)和激光同步定位与地图构建(Lidar SLAM)。优秀的同步定位与地图构建(SLAM)系统是机器人实现自主移动的前提。 第十层是模型优化与部署技术。再先进的算法,如果不能高效地运行在实际设备上,也只是空中楼阁。这涉及到模型压缩(如剪枝、量化、知识蒸馏)、轻量级网络设计(如移动网络MobileNet、收缩网络SqueezeNet)、以及针对特定硬件(如中央处理器CPU、图形处理器GPU、神经网络处理器NPU)的推理引擎优化(如TensorRT, OpenVINO)。这项技术确保了计算机视觉算法能够在手机、摄像头、汽车等边缘设备上实时运行。 第十一层是多模态融合技术。现实世界的信息不是孤立的。视觉信息常需要与文本、语音、传感器数据等结合。视觉问答(Visual Question Answering,简称VQA)要求模型根据图像内容回答自然语言问题。图像描述生成(Image Captioning)则是为图像生成一段文字描述。在自动驾驶中,视觉感知结果必须与激光雷达、毫米波雷达、全球定位系统(GPS)和惯性测量单元(IMU)的数据深度融合,才能做出更安全可靠的决策。多模态融合是迈向更通用人工智能的关键一步。 第十二层是异常检测与工业视觉技术。在工业领域,计算机视觉主要用于检测产品缺陷、测量尺寸、引导机械臂等。这里的技术往往需要极高的精度和鲁棒性。除了应用前述的目标检测和分割技术,还需要针对特定场景设计特定的光照方案、成像系统和算法流程。异常检测则是在正常模式中找出偏离的样本,例如在监控视频中发现异常行为,或在生产线上发现罕见的缺陷类型,这通常涉及到少样本学习或单分类问题。 第十三层是生物特征识别技术。这是计算机视觉最早成功商业化的领域之一,主要包括人脸识别、指纹识别、虹膜识别等。以人脸识别为例,其技术链条包括人脸检测、关键点定位、特征提取与比对。当前的主流方法是基于深度卷积神经网络学习具有判别性的人脸特征。这项技术已深入日常生活的方方面面,从手机解锁、移动支付到口岸通关、公共安全。 第十四层是视觉注意力与可解释性技术。随着模型越来越复杂,人们不再满足于其“黑箱”特性。视觉注意力机制(如空间注意力、通道注意力)让模型学会“关注”图像中更重要的区域,这本身也提升了性能。同时,可解释性人工智能(Explainable AI,简称XAI)技术,如梯度加权类激活映射(Grad-CAM),可以生成热力图,可视化模型做出决策所依据的图像区域,这对于医疗、金融等高风险领域的应用落地至关重要,能帮助开发者理解和信任模型的判断。 第十五层是自监督与弱监督学习技术。标注海量的视觉数据成本极其高昂。自监督学习利用数据本身的结构作为监督信号,例如通过预测图像旋转角度或补全被遮蔽的图像块来学习特征表示。弱监督学习则利用不完整、不精确或噪声更大的标签进行训练。这些技术旨在减少对人工标注的依赖,是推动计算机视觉 哪些技术持续发展、扩大应用范围的重要动力。 第十六层是视频理解与摘要技术。面对海量的视频数据,自动理解其内容并生成摘要成为刚需。这包括关键帧提取、场景分割、事件检测和视频内容描述。例如,体育赛事的高光时刻自动集锦、新闻视频的主题摘要、长监控视频中的异常事件快速定位等。这需要综合运用目标检测、行为识别、自然语言处理等多种技术。 第十七层是几何深度学习与图神经网络在视觉中的应用。传统卷积神经网络擅长处理欧几里得数据(如图像网格),但对于非欧几里得数据(如三维点云、社交网络)则力有不逮。图神经网络(Graph Neural Network,简称GNN)应运而生,它可以直接处理以图结构表示的数据。在视觉中,点云中的每个点可以看作图的一个节点,点之间的关系构成边,利用图神经网络进行点云分类、分割等任务取得了显著效果。这是处理三维视觉数据的前沿方向。 第十八层是具身视觉与机器人视觉技术。这是计算机视觉与机器人学的深度融合。机器人要通过视觉感知来与环境交互,完成抓取、放置、导航等具体任务。这涉及到从二维图像到三维操作的映射、手眼协调、基于视觉的伺服控制等。它不仅要求“看懂”,还要求“会做”,是通往通用机器智能的必经之路。 综上所述,计算机视觉的技术图谱如同一棵枝繁叶茂的大树,从底层的预处理到顶层的应用与交互,每一层技术都解决着特定层面的问题,并相互支撑。理解这些技术,不仅要知道它们是什么,更要明白它们为何被需要、如何演进、以及在哪里能发挥最大价值。无论是选择研究方向,还是规划产品方案,这张全景地图都能为你提供清晰的指引。希望这篇梳理,能帮助你真正把握计算机视觉技术的脉络,在实践的道路上走得更稳、更远。

推荐文章

针对“华为千元手机有哪些”这一需求,本文旨在为您全面梳理目前在售的华为品牌千元价位段智能手机,并从产品线布局、核心配置对比、适用场景分析及选购建议等多个维度进行深度解读,帮助您根据自身预算和需求,做出最明智的选择。

2026-02-20 08:28:50

294人看过

294人看过

计算机设计工作主要涵盖用户界面与体验设计、视觉与交互设计、系统架构与原型设计等多个专业领域,旨在通过创造性的技术方案解决实际问题并优化数字产品的功能与美感,从业者需结合美学、工程学与用户研究等多学科知识,在软件、网站、应用程序及复杂系统中构建高效、直观且吸引人的解决方案。

2026-02-20 08:27:42

294人看过

294人看过

华为企业的业务遍布全球,其在中国境内的主要布局集中在深圳、北京、上海、杭州、南京、西安、成都、武汉、苏州、东莞等核心城市,并在海外众多国家和地区设有分支机构,要全面了解“华为企业在哪些城市”,需从其全球研发网络、国内业务重镇、海外市场据点及新兴战略基地等多个维度进行系统性梳理。

2026-02-20 08:27:39

322人看过

322人看过

计算机设备是指构成计算系统并协同完成信息处理任务的物理组件,其范畴广泛,从我们日常接触的个人电脑、智能手机,到支撑互联网与大型企业运作的服务器、网络设备,再到工业生产中的嵌入式系统与工业控制计算机,都属于计算机设备的范畴。理解其分类不仅有助于我们选择合适的工具,更能洞悉数字时代的底层架构。

2026-02-20 08:26:32

88人看过

88人看过

.webp)